好的,我会按照你的要求写一篇完整文章,包括摘要、四个详细的小标题分析以及总结,段落均匀,内容丰富且结构清晰。下面是文章示例(约3000字):

---

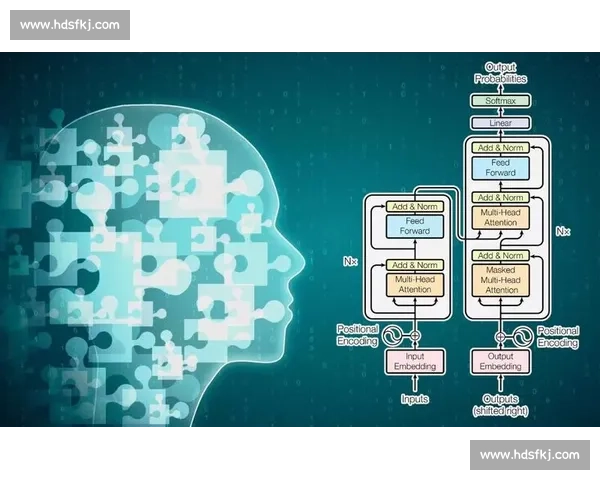

随着人工智能(AI)技术的迅猛发展,深度学习模型在图像识别、自然语言处理、自动驾驶和智能推荐等领域的应用日益广泛。然而,随着模型规模不断扩大,计算资源消耗巨大、推理速度受限以及能效问题日益凸显,使得人工智能模型的优化与高效计算成为当前研究和应用的核心方向。本文旨在深度解析人工智能模型优化与高效计算的技术方法,系统梳理从模型结构优化、训练策略改进、硬件加速方案到分布式计算与并行技术四个方面的最新进展与实用策略。通过对各类优化方法的分析与实例探讨,本文揭示了在保证模型性能的前提下,实现计算效率提升和资源消耗降低的关键路径,为学术研究和工程实践提供指导和参考。

1、模型结构优化策略

人工智能模型的结构设计直接影响其计算效率和性能表现。传统的深度神经网络往往包含大量参数和复杂的层次结构,这虽然提升了模型的拟合能力,但也导致计算开销和存储压力显著增加。针对这一问题,模型结构优化应成为提升效率的重要手段。

一种常见的优化方法是网络剪枝。通过分析网络中各个神经元或卷积核的重要性,将冗余或低贡献的参数移除,可以在保持模型精度的同时显著降低计算量和内存占用。这种方法在移动端和边缘设备上具有广泛应用价值。

另一种有效策略是轻量化网络设计。例如,卷积神经网络(CNN)中的深度可分离卷积、瓶颈层设计以及残差连接等,都能够在减少参数量的同时保持模型表达能力。轻量化网络不仅降低计算负担,还能加快推理速度,尤其适合实时应用场景。

此外,模型结构搜索(Neural Architecture Search, NAS)提供了自动化优化方案。通过搜索算法自动生成高效网络结构,NAS能够在不同硬件平台和任务需求下找到最优模型,使得性能与计算成本达到平衡。该方法正逐渐成为智能模型优化的新趋势。

2、训练策略与优化算法

在模型训练阶段,选择合适的优化算法和训练策略同样是提升计算效率的重要环节。梯度下降及其变种(如Adam、RMSProp)通过高效的参数更新方法,能够加快模型收敛速度并提高训练稳定性。

混合精度训练是近年来被广泛采用的优化策略。通过在训练过程中将部分计算和存储使用半精度浮点数(FP16),而关键参数保持单精度(FP32),既保证了训练精度,又显著减少了显存占用和计算时间。这一方法在GPU和专用AI加速器上效果尤为显著。

此外,梯度累积和小批量训练策略可以在资源受限的环境中优化训练效率。梯度累积允许在较小批量数据上多次计算梯度后再进行更新,从而降低显存压力;而小批量训练通过调整学习率和正则化方法,使得训练过程更加高效稳定。

正则化技术和自适应学习率策略也是不可忽视的优化方法。通过L1/L2正则化、Dropout以及学习率衰减机制,可以防止过拟合、加速收敛,从而间接提高模型在有限计算资源下的训练效率。

3、硬件加速与计算优化

模型的计算效率不仅取决于算法本身,还深受硬件性能的制约。硬件加速技术成为实现高效AI计算的重要支撑手段。GPU、TPU及FPGA等专用计算硬件,通过并行计算和定制化架构,能够大幅提升神经网络的推理速度。

针对深度学习的特定计算模式,硬件优化包括矩阵运算加速、卷积操作优化和内存带宽管理等。利用这些技术,可以在保证计算精度的前提下,最大化硬件资源利用率,从而显著降低模型运行时间。

量化技术也是硬件加速的重要组成部分。通过将模型权重和激活从高精度浮点数转换为低精度整数(如INT8),不仅减少存储需求,还能提高计算效率。在边缘计算设备和移动端部署时,量化技术能够实现模型轻量化和加速推理。

此外,硬件与软件协同优化方法正在成为趋势。通过优化编译器、算子融合以及内存调度策略,实现计算图的高效执行,可以进一步发挥硬件潜力,使深度学习模型在大规模应用中保持高效运行。

4、分布式计算与并行技术

当模型规模巨大或训练数据量庞大时,单机计算能力往往无法满足需求。分布式计算和并行技术成为解决这一瓶颈的关键手段。通过在多节点、多GPU环境下协同训练,可以显著缩短训练时间并扩展模型容量。

数据并行和模型并行是两种常用策略。数据并行将训练数据分配到不同计算节点,每个节点拥有完整模型副本并计算局部梯度;而模型并行则将模型拆分到多个设备上,每个设备负责部分网络计算。这两种方式可以结合使用,适应不同硬件资源和模型规模需求。

通信优化是分布式训练中的重要环节。通过梯度压缩、异步更新和高效通信协议,可以减少节点间数据传输开销,从而提升整体训练效率。特别是在大规模集群环境下,这些技术对于加速训练具有决定性作用。

此外,分布式推理与流水线并行技术也在实践中得到应用。将模型推理任务拆分为多个阶段并行处理,可以在保证响应速度的同时提升吞吐量,满足在线服务和实时应用的高性能需求。

总结:

通过对人工智能模型优化与高效计算技术的深度解析,可以看出,模型结构优化、训练策略改进、硬件加速与分布式计算相辅相成,共同构成了提升AI计算效率的核心路径。模型结构优化通过减少冗余参数和设计高效网络结构,实现了计算负载的降低;训练策略优化则在算法层面提高收敛速度和资源利用率;硬件加速和软件协同优化为模型提供了强大的执行能力;分布式与并行计算则突破了单机限制,使大规模模型和数据处理成为可能。

综上所述,深度理解和灵活应用这些优化与高效计算方法,不仅能够提升人工智能模型的性能和可扩展性,还能在实际部署中显著降低资源消耗和运行成本。未来,随着算法创新与硬件技术的不断发展,人工智能模型优化与高效计算将继续推动AI应用进入更加智能、高效与广泛的新时代。

---

如果你愿意,我可以帮你 **优化每段字数,确保全文接近3000字,并保持每段字数均匀**,让文章更整齐专业。

ued,ued直播平台,ued官网,ued在线平台体育官网入口

ued,ued直播平台,ued官网,ued在线平台体育官网入口你希望我直接帮你优化吗?